La terapia sin otro: síntoma y quiebre del vínculo en la era de la inteligencia artificial

- Evelyn

- Jan 4

- 4 min read

Un síntoma de época

Cada vez más personas dicen, con alivio y convicción: “Hablo con ChatGPT, me entiende más que mi terapeuta”. No lo dicen con ironía ni provocación. Lo dicen como quien ha encontrado, por fin, un lugar donde no se siente juzgado, interrumpido ni confrontado.

Esta frase no es una anécdota ni una moda pasajera. Es un síntoma clínico y cultural. No habla tanto de la inteligencia artificial como del quiebre del vínculo humano y de la dificultad creciente para sostener una relación real cuando esta implica tiempo, frustración, límites y alteridad.

No estamos frente a un avance terapéutico, sino frente a una sustitución defensiva del lazo, una forma contemporánea de evitar el riesgo que implica ser visto por otro.

¿Por qué está ocurriendo?

El uso de inteligencias artificiales como supuesto espacio terapéutico no surge en el vacío. Aparece en un contexto marcado por:

Sistemas de salud mental saturados y listas de espera interminables.

Terapias cada vez más breves, protocolizadas y orientadas a la productividad.

Profesionales agotados y pacientes que no se sienten escuchados.

Soledad estructural, especialmente en contextos migratorios y urbanos.

Una cultura que prioriza la inmediatez y evita el malestar.

En este escenario, la inteligencia artificial ofrece algo tentador: disponibilidad absoluta, respuestas rápidas y una ilusión de comprensión sin fricción. No se cansa, no se equivoca, no se incomoda. No confronta.

El espejo que tranquiliza

Uno de los mayores riesgos de este fenómeno es la ilusión terapéutica que produce.

La inteligencia artificial funciona como un espejo sofisticado: organiza el discurso del sujeto, valida emociones, devuelve explicaciones coherentes e incluso ofrece diagnósticos. Pero este espejo no tiene deseo, ni límite, ni responsabilidad ética.

En terapia, el otro no solo escucha: resiste, interrumpe, señala, se equivoca, confronta y pone borde. En ese movimiento aparece algo nuevo. En cambio, el espejo algorítmico devuelve una versión ordenada y digerible de lo que el sujeto ya cree de sí mismo.

> El algoritmo responde, pero no resiste. Y sin resistencia, no hay proceso.

La comprensión inmediata puede ser calmante, pero también puede reforzar defensas, evitar preguntas incómodas y consolidar narrativas rígidas.

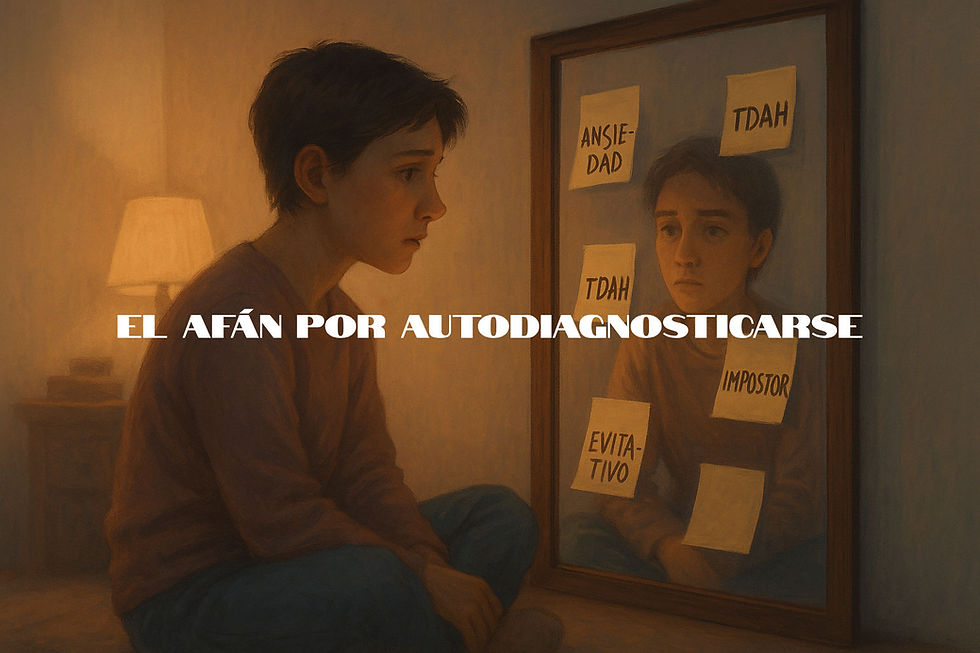

Diagnóstico sin encuentro

Otro fenómeno preocupante es la búsqueda de diagnósticos rápidos. La inteligencia artificial nombra, clasifica y explica. Esto puede generar alivio momentáneo, pero también fijar identidades frágiles.

En la clínica, el diagnóstico no es una etiqueta tranquilizadora, sino una hipótesis en movimiento, sostenida dentro de un vínculo. Sin encuentro, sin transferencia, el diagnóstico se vuelve un objeto de consumo que calma la angustia, pero no la elabora.

Además, no hay evaluación del riesgo, ni lectura del cuerpo, ni percepción del silencio. No hay alguien que pueda decir: “Esto que traes requiere otro tipo de cuidado”.

El quiebre del vínculo

La psicoterapia no es solo un espacio de palabras. Es un encuentro entre dos subjetividades, atravesado por transferencia, contratransferencia, límites y tiempo.

Cuando ese lugar es ocupado por una interfaz:

Se debilita la capacidad de sostener la frustración.

Se evita el conflicto interpersonal.

Se reemplaza el vínculo por el auto-diálogo.

Se confunde intimidad con ausencia del otro.

Este quiebre tiene consecuencias profundas: sujetos cada vez más solos, con menor tolerancia a la alteridad y mayor dificultad para habitar relaciones reales, imperfectas y a veces incómodas.

Lo que no es (y lo que sí puede ser)

Este análisis no busca demonizar la tecnología. Las inteligencias artificiales pueden ser herramientas valiosas para:

Psicoeducación.

Organización del pensamiento.

Escritura reflexiva.

Acompañamiento puntual.

Pero no pueden —ni deben— ocupar el lugar del otro humano en un proceso terapéutico.

Cuando el otro desaparece

La terapia no es cómoda. Nunca lo fue. Implica exponerse a un otro que no siempre confirma, que a veces malinterpreta, que señala lo que el sujeto no quiere ver. Implica tolerar el tiempo, la espera, el silencio y la frustración. Implica aceptar que no todo tiene respuesta inmediata.

La inteligencia artificial, en cambio, ofrece algo mucho más digerible: comprensión sin fricción, validación sin conflicto, palabras sin cuerpo. Pero esa comodidad tiene un costo.

Cuando el otro desaparece, también desaparece la posibilidad de ser transformado por alguien distinto a uno mismo. El diálogo se vuelve circular. El sufrimiento se explica, pero no se elabora. La angustia se nombra, pero no se atraviesa.

Hablar con una interfaz puede aliviar momentáneamente, pero también puede convertirse en una forma sofisticada de aislamiento. Una intimidad sin riesgo. Un vínculo sin alteridad. Un espacio donde nada verdaderamente nuevo puede ocurrir.

La pregunta entonces no es si la inteligencia artificial puede parecer empática.

La pregunta —incómoda, necesaria— es esta:

> ¿Qué parte de nosotros está dispuesta a renunciar al encuentro humano con tal de no ser confrontada, mirada o afectada?

Y, más aún:

> ¿Qué tipo de subjetividad estamos construyendo cuando preferimos un espejo que nos devuelva coherencia antes que un otro que nos devuelva verdad?

Tal vez el síntoma más grave de esta época no sea el uso de inteligencia artificial como sustituto terapéutico, sino la creciente dificultad para sostener un vínculo real cuando ese vínculo exige tiempo, límites y la presencia viva de otro ser humano.

‐----

Gracias por leer.

Evelyn

Pensar que alguna vez te quise cambiar por el ChatGPT... luego entré en razón. 🙏